AI Act: accordo politico sul Digital Omnibus. Cosa cambia per le imprese.

Il 7 maggio 2026, nelle prime ore del mattino, Consiglio UE e Parlamento europeo hanno raggiunto un accordo politico provvisorio sull'Omnibus VII relativo all'AI Act (Press Release Consiglio 299/26). Il via libera del Coreper è arrivato il 15 maggio. Cinque punti chiave che cambiano concretamente il quadro operativo per le imprese.

Il contesto: perché un accordo politico adesso

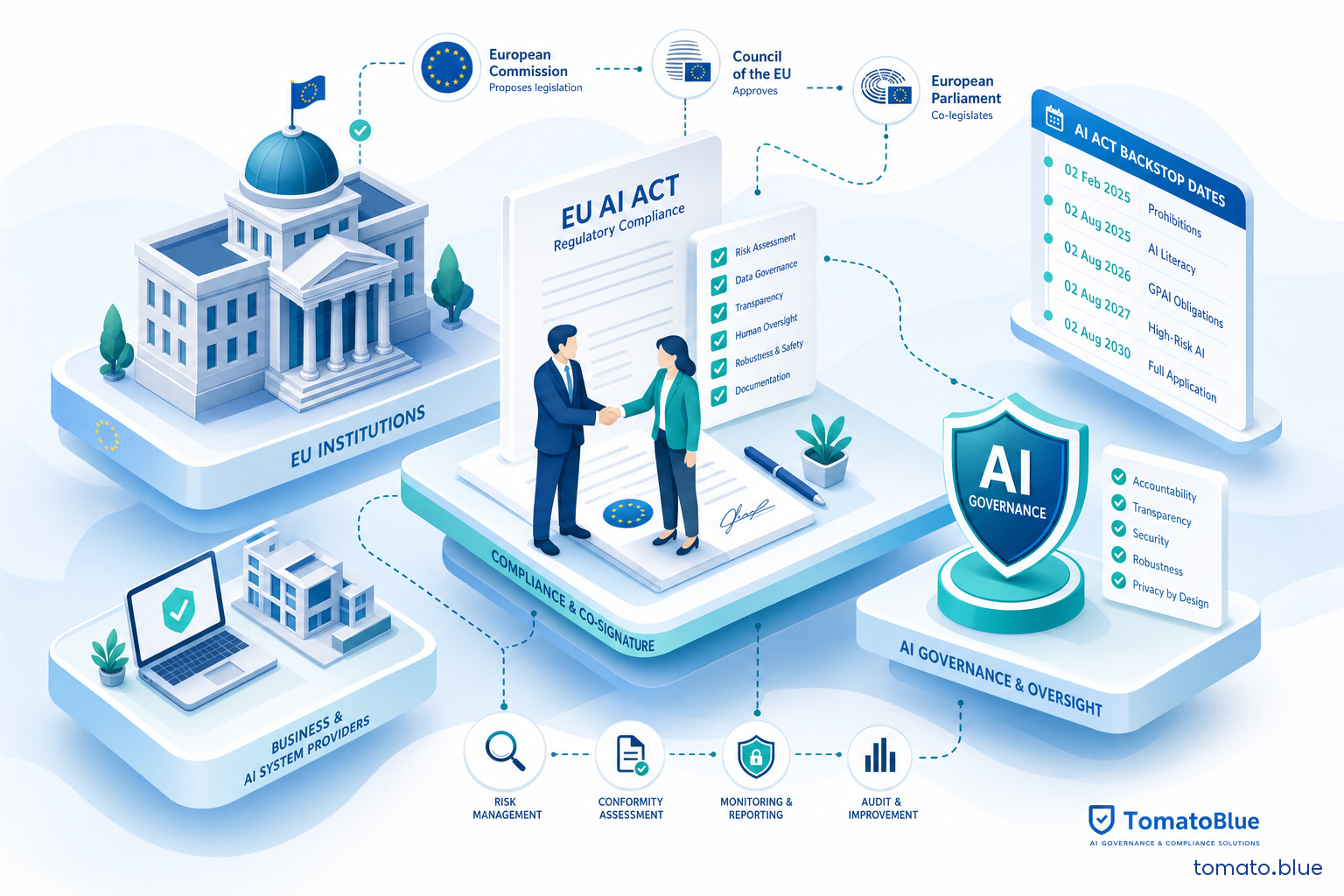

L'AI Act è in vigore dal 1° agosto 2024. La prima scadenza operativa rilevante — l'applicazione degli obblighi per i sistemi ad alto rischio standalone (Annex III) — era fissata al 2 agosto 2026. Con meno di tre mesi a quella data, molte organizzazioni si trovavano a dover gestire un percorso di conformità su standard armonizzati ancora incompleti, strumenti di implementazione non consolidati e incertezza interpretativa diffusa.

Il pacchetto Digital Omnibus, proposto dalla Commissione nel novembre 2025, nasce da questa pressione. L'accordo politico del 7 maggio ne cristallizza i contenuti principali, anticipando l'adozione formale attesa per giugno-luglio 2026 dopo il voto in plenaria del Parlamento europeo.

Attenzione: fino al voto in plenaria e all'adozione formale del Consiglio, la scadenza del 2 agosto 2026 resta de iure vincolante. La strategia corretta è la doppia traccia: mantenere la roadmap originaria come fallback, calibrare gli investimenti di compliance sul nuovo orizzonte.

1. Date fisse, non più ancorate agli standard

La modifica più rilevante per la pianificazione operativa riguarda il meccanismo di attivazione degli obblighi per i sistemi ad alto rischio. L'AI Act originario prevedeva che gli obblighi entrassero in vigore un certo numero di mesi dopo la pubblicazione degli standard armonizzati — un meccanismo che creava incertezza strutturale, perché i tempi di standardizzazione dipendono da organismi terzi (CEN/CENELEC) su cui le imprese non hanno controllo.

L'accordo politico sostituisce questo meccanismo con date fisse (backstop):

| Categoria | Nuova scadenza |

|---|---|

| Sistemi AI high-risk standalone (Annex III) | 2 dicembre 2027 |

| Sistemi AI high-risk embedded in prodotti regolati (Annex I) | 2 agosto 2028 |

Le backstop dates non sono rinvii indefiniti: sono scadenze ferme, indipendenti dallo stato di avanzamento degli standard. Se gli standard armonizzati arrivano prima, le regole si applicano prima. Il guadagno reale è la certezza del termine massimo, che consente finalmente di costruire roadmap credibili.

2. Watermarking: sette mesi, non un esercizio documentale

L'obbligo di marcatura macchina-leggibile dei contenuti sintetici generati da AI — previsto dall'art. 50(2) dell'AI Act — era accompagnato da un grace period di sei mesi per l'adozione di standard tecnici. L'accordo politico riduce questo grace period a tre mesi, con scadenza al 2 dicembre 2026.

Il watermarking machine-readable non è una formalità. Richiede l'integrazione di tecnologie di marcatura (watermark nei metadati, C2PA, hash crittografici) nei sistemi di produzione dei contenuti, la revisione dei flussi di pubblicazione, e la verifica della catena di custodia del segnale nei sistemi downstream. Per le organizzazioni che producono contenuti sintetici in scala — immagini, video, audio, testo — si tratta di un progetto tecnico con un orizzonte temporale di sette mesi dalla data odierna.

Il messaggio implicito dell'accordo è chiaro: il Legislatore europeo considera il watermarking un prerequisito non negoziabile per l'ecosistema informativo, non uno dei tanti adempimenti da inserire in una checklist.

3. Divieto esplicito per nudifier e CSAM

L'accordo introduce una nuova pratica vietata all'art. 5: la generazione tramite AI di contenuti sessuali o intimi non consensuali e di materiale pedopornografico (CSAM). Il divieto va oltre la proposta originaria della Commissione, che non includeva questa fattispecie in modo esplicito.

La rilevanza operativa per le imprese è duplice. In primo luogo, i provider di modelli generativi che operano in Europa devono verificare che i propri sistemi non possano essere utilizzati per produrre questi contenuti — il che implica obblighi di filtro e controllo a monte. In secondo luogo, le piattaforme di distribuzione che veicolano contenuti AI-generated devono implementare meccanismi di rilevamento e rimozione conformi al nuovo divieto, in coordinamento con quanto già previsto dal DSA.

Per le PMI che non operano in questi ambiti il punto è rilevante in chiave di due diligence sui propri fornitori di strumenti AI.

4. Registrazione art. 6(4) reinserita

Durante il processo legislativo era emersa una tensione interpretativa sull'obbligo di registrazione nel database UE per i sistemi che i provider ritengono esenti dalla qualifica di alto rischio. Il Consiglio aveva proposto di eliminare questo obbligo nella fase di trilogo con il Parlamento; l'accordo del 7 maggio lo reinserisce.

In pratica: se un provider sviluppa o mette in commercio un sistema che rientra nelle categorie dell'Annex III ma ritiene che non presenti un rischio significativo ai sensi dell'art. 6(4), deve comunque registrarlo nel database europeo dell'AI Office, indicando le motivazioni dell'esenzione. L'obbligo di registrazione diventa così un meccanismo di trasparenza e accountability, non un onere amministrativo formale.

Per le imprese che hanno già effettuato una classificazione dei propri sistemi AI, questo punto impone una verifica: tutti i sistemi che rientrano nell'Annex III, inclusi quelli classificati come non ad alto rischio, devono essere censiti nel registro.

5. Bias detection: standard di stretta necessità ex art. 4a

L'art. 4a dell'AI Act, introdotto in fase di trilogo, prevedeva la possibilità di trattare categorie particolari di dati personali (dati sensibili ex art. 9 GDPR: origine razziale ed etnica, dati sulla salute, orientamento sessuale, ecc.) per finalità di rilevazione e correzione dei bias nei sistemi AI.

L'accordo politico ripristina lo standard di stretta necessità per questo trattamento, allineandosi alla Joint Opinion EDPB/EDPS 1/2026. In pratica, il trattamento di dati sensibili per bias detection è ammesso solo se strettamente necessario allo scopo e non sostituibile con dati meno sensibili. Le organizzazioni che hanno implementato — o stanno progettando — programmi di fairness testing sui propri modelli AI devono verificare che la base giuridica e la proporzionalità del trattamento siano conformi a questo standard rafforzato.

Cosa fare adesso: la strategia della doppia traccia

Il rinvio delle scadenze è reale, ma non è una pausa. È il tempo per costruire bene quello che ad agosto 2026 sarebbe stato costruito male, sotto pressione, senza standard definitivi e con risorse dedicate alla contingenza anziché alla qualità.

La strategia operativa consigliata per le organizzazioni che trattano sistemi AI ad alto rischio è la doppia traccia:

- Traccia 1 — Fallback: mantenere attiva la roadmap originaria orientata al 2 agosto 2026. Non smantellare i programmi di compliance già avviati. Le attività già completate (classificazione dei sistemi, gap analysis, documentazione tecnica) hanno valore permanente e accelerano la conformità sulla nuova scadenza.

- Traccia 2 — Ottimizzazione: ricalibrare gli investimenti sul nuovo orizzonte 2027-2028. Il tempo aggiuntivo consente di attendere gli standard armonizzati definitivi, di costruire sistemi di governance AI più maturi e di integrare la compliance AI nel ciclo di vita dei prodotti anziché trattarla come un adempimento a sé stante.

Le scadenze che non cambiano — watermarking al 2 dicembre 2026, obblighi sui modelli GPAI, divieti assoluti — richiedono attenzione immediata. Il calendario non è omogeneo, e pianificare come se tutto slittasse sarebbe un errore.

Prossimi passi istituzionali

L'accordo del 7 maggio è politico, non giuridicamente vincolante. Il percorso formale prevede:

- Voto in plenaria del Parlamento europeo (previsto giugno 2026)

- Adozione formale del Consiglio

- Pubblicazione in Gazzetta Ufficiale UE ed entrata in vigore

Fino all'adozione formale, la scadenza del 2 agosto 2026 rimane l'unico termine legalmente vincolante. Le organizzazioni devono tenerlo presente nella comunicazione interna e verso gli stakeholder: annunciare che "l'AI Act è stato rinviato" sarebbe tecnicamente impreciso e operativamente rischioso.

Come impatta il tuo programma di compliance AI Act?

Tomato Blue supporta PMI e imprese nella classificazione dei sistemi AI, gap analysis e costruzione di roadmap conformi alle nuove scadenze. Contattaci per un confronto senza impegno.

Contattaci